Recientemente, un par de casos judiciales históricos encontraron culpables a Meta y YouTube por perjudicar a sus usuarios jóvenes mediante el diseño de algoritmos adictivos que conducen a problemas de salud mental. Las compensaciones impuestas a estas empresas representan solo una fracción de su ingreso anual. Sin embargo, las implicaciones a largo plazo podrían ser mucho más significativas.

Las decisiones judiciales establecieron que los algoritmos programados no están protegidos por la Sección 230, la ley federal que protege a las empresas de redes sociales de la responsabilidad por el contenido publicado por los usuarios. Esto representa una fisura en una defensa legal de la que estas compañías han dependido durante años. Además, miles de casos similares ya están pendientes.

La Sección 230 ha estado bajo escrutinio desde hace algún tiempo. Los legisladores han llamado repetidamente a su derogación, aunque hasta ahora los esfuerzos han fracasado en ganar tracción. Muchos en el Congreso parecen ver la amenaza de derogar esta ley como una palanca, con la esperanza de que empuje a las empresas tecnológicas a negociar cambios que reflejen la evolución de Internet desde que se aprobó la ley.

“La Sección 230 fue creada durante los primeros años de la Internet, cuando los legisladores intentaban dar espacio a las empresas en línea emergentes para innovar y experimentar con tecnologías que el público y los responsables de políticas apenas comprendían”, dice J.B. Branch, Consejero de Gobernanza de IA y Política Tecnológica en Public Citizen. “Nunca se pretendió que funcionara como un escudo legal permanente para algunas de las corporaciones más poderosas del mundo.”

Replanteando el argumento

¿Ha perdido la Sección 230 su poder protector? Aún no.

El principio fundamental de la ley sigue en pie: las empresas no son responsables por el contenido generado por los usuarios. Lo que ha cambiado es la manera en que los demandantes pueden eludir esa protección. Los nuevos casos se centran menos en lo que los usuarios publican y más en cómo están diseñadas las plataformas.

En otras palabras, el diseño del producto podría ser la mayor vulnerabilidad legal.

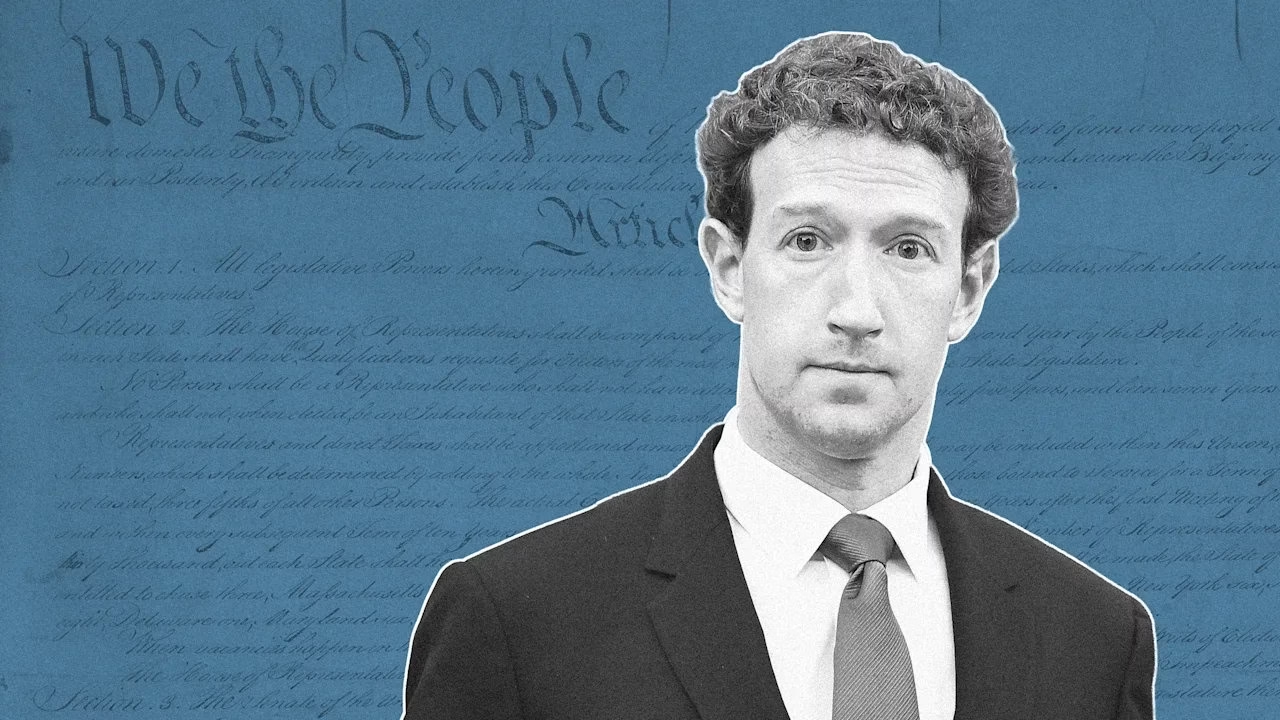

“Los CEOs como Mark Zuckerberg, Tim Cook y Evan Spiegel deben repensar cómo diseñan los productos que utilizan los niños, porque ya no pueden esconderse completamente detrás de la Sección 230”, afirma Sarah Gardner, CEO de Heat Initiative, una organización centrada en la seguridad en línea para niños.

Este cambio asume que las decisiones sobrevivirán a las apelaciones. Se espera que Meta y YouTube impugnen las decisiones, lo que probablemente dará lugar a una batalla legal que podría llegar eventualmente a la Corte Suprema. Aun así, el debate más amplio ya ha comenzado.

Responsabilidad forzada

Las implicaciones son significativas, especialmente en lo que respecta a los usuarios más jóvenes. Las decisiones empujan a las empresas hacia un nivel de responsabilidad que, en ciertos aspectos, refleja la trayectoria de la industria del entretenimiento para adultos.

Es una comparación imperfecta, pero hay paralelismos, dice Ramnath Chellappa, profesor en la Escuela de Negocios Goizueta de la Universidad de Emory. Los sitios para adultos han sido cada vez más obligados a verificar la edad de sus usuarios. Mecanismos similares podrían surgir para las redes sociales.

“El mecanismo para monitorear… para asegurar que un menor sea un menor y así sucesivamente es ya un tema muy complejo”, dice. “¿Qué implica eso? ¿Involucra a un tercero, o es necesario compartir la información de la licencia de manejar?”

Lexi Hazam de Lieff Cabraser Heimann & Bernstein, LLP, co-líder de la MDL de Redes Sociales, coincide en que las decisiones podrían forzar cambios operativos importantes, aunque evita hacer una comparación directa.

“Las implicaciones son significativas y muestran a estos gigantes tecnológicos que ninguna empresa está por encima de la responsabilidad cuando se trata de nuestros niños”, dice. “Las empresas tendrán que reevaluar cómo diseñan y operan sus plataformas en el futuro… lo que podría requerir que las empresas realicen cambios reales, incluyendo un diseño de plataforma más seguro, verificación de edad efectiva, y controles parentales que realmente funcionen para proteger a los usuarios jóvenes.”

No todos ven el debilitamiento de la Sección 230 como algo benéfico. Los críticos argumentan que el actual debate sobreenfatiza los daños mientras pasa por alto los beneficios.

“El debate público sobre las redes sociales y la salud mental de los jóvenes se centra casi exclusivamente en los daños potenciales”, escribieron Ben Sperry y Sabrina Pekarovic del Centro Internacional de Derecho y Economía en un ensayo reciente, argumentando que este énfasis minimiza las formas en que las plataformas pueden permitir la autoexpresión y conectar a los adolescentes con comunidades más amplias. Añaden que tratar a todos los adolescentes como igualmente vulnerables simplifica el problema y no está respaldado por la evidencia. “Las prohibiciones generales suponen que todos los adolescentes enfrentan riesgos similares y deben ser tratados por igual”, escribieron. “La evidencia sugiere lo contrario.”

Un momento ‘Big Tobacco’

Algunos observadores han comparado las decisiones con un momento “Big Tobacco” para las redes sociales, un reckoning largamente esperado que podría llevar a una regulación amplia.

Eso podría incluir cambios a la Sección 230 o una revisión más amplia de cómo operan las plataformas. Cualquiera de estos resultados tendría consecuencias financieras importantes para las empresas que han sido jugadores dominantes en Wall Street.

El impacto potencial sobre los inversores es considerable. Un informe de la Asociación de Industria de Computación y Comunicaciones estima que derogar la Sección 230 podría costar a los inversores $2.2 billones y llevar a aproximadamente 1.1 millones de demandas por año contra empresas de servicios digitales.

Algunos analistas creen que la dirección ya es clara.

“Las consecuencias para las redes sociales serán devastadoras”, dice Igor Pejic, estratega en inversiones tecnológicas y autor de Tech Money. “La regulación aumentará tal como ocurrió con la industria del tabaco y un día podríamos ver cosas como la autenticación de ID requerida. Esta tendencia regulatoria no matará a las redes sociales, pero creo que en un par de años al menos perderán su estatus como empresa de Big Tech.”